上一篇

上下文窗口是什么意思?上下文窗口(Context Window)详细介绍NSA是什么意思?NSA(Native Sparse Attention)详细介绍

NSA(Native Sparse Attention)是DeepSeek提出的一种新型稀疏注意力机制,通过算法创新和硬件优化提升长文本建模的效率。NSA的核心在于动态分层稀疏策略,结合粗粒度的Token压缩和细粒度的Token选择,同时保留全局上下文感知能力和局部精确性。

什么是NSA

NSA(Native Sparse Attention )是DeepSeek提出的一种新型稀疏注意力机制,通过算法创新和硬件优化提升长文本建模的效率。核心在于动态分层稀疏策略,结合粗粒度的Token压缩和细粒度的Token选择,同时保留全局上下文感知能力和局部精确性。NSA通过硬件对齐优化,充分基于现代GPU的Tensor Core特性,显著提升计算效率。

NSA的工作原理

NSA的工作原理基于动态分层稀疏策略,结合了粗粒度的Token压缩和细粒度的Token选择,同时通过滑动窗口保留局部上下文信息。具体来说,NSA的工作机制如下:

Token压缩:将连续的键(Key)和值(Value)聚合为块级表示,捕获全局上下文的粗粒度信息。

Token选择:基于块的重要性评分,选择关键的Token块进行细粒度计算,保留重要信息。

滑动窗口:为局部上下文信息提供额外的注意力路径,确保模型能捕捉局部连贯性。

NSA通过硬件对齐优化,充分基于现代GPU的Tensor Core特性,减少内存访问和硬件调度瓶颈。支持端到端的训练,减少了预训练计算成本,同时保持了模型性能。实验表明,NSA在处理64k长度的序列时,在解码、前向传播和反向传播阶段均实现了显著的加速。

NSA能做什么?

深度推理(In-depth Reasoning):NSA在处理需要深度推理的任务时表现出色,例如在数学问题求解、逻辑推理等方面。这些任务需要模型理解和处理长序列的依赖关系。

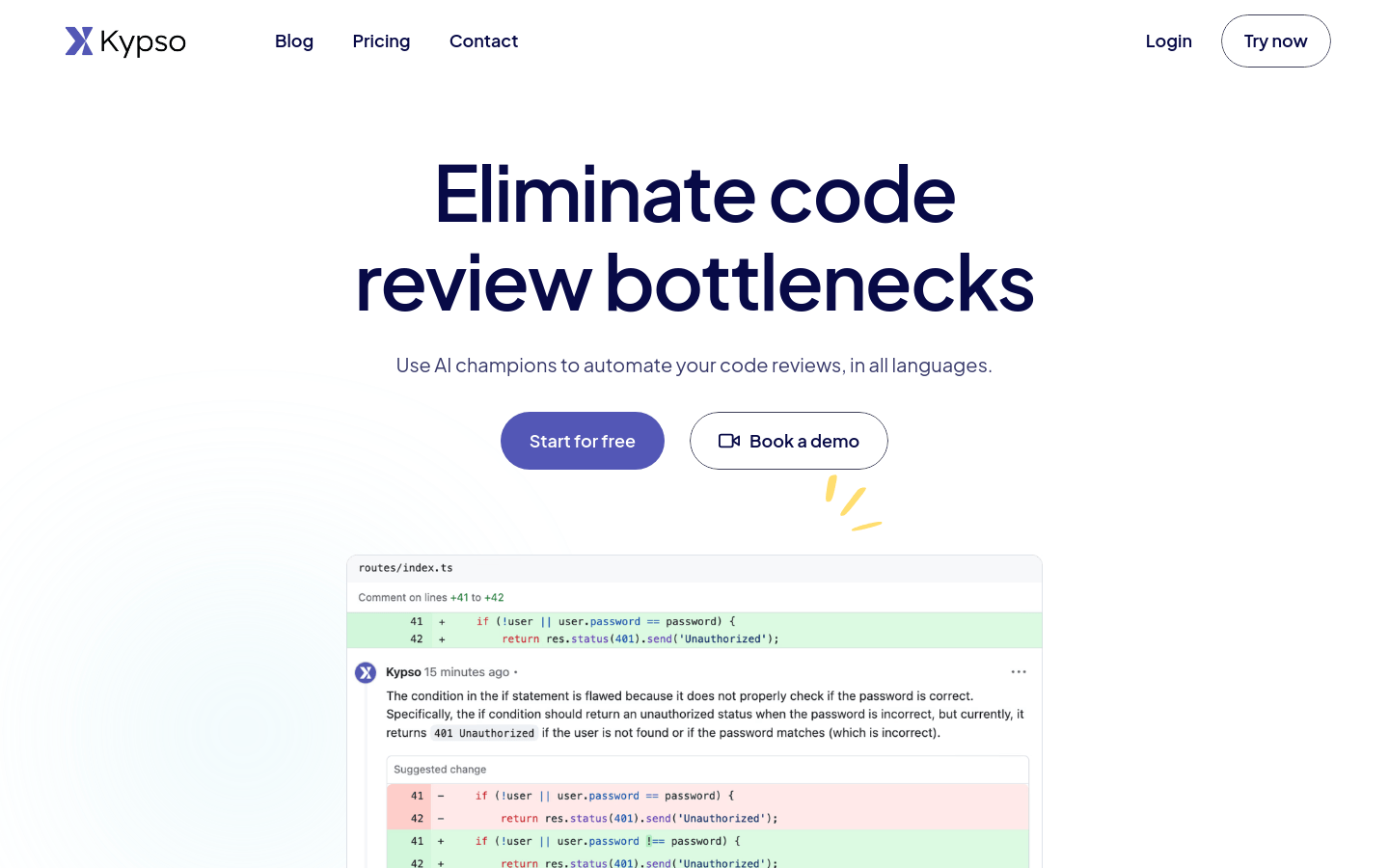

代码生成(Code Generation):在代码生成领域,NSA能处理整个代码库级别的文本。在生成代码或者进行代码相关的任务时,能理解和利用更广泛的上下文信息,生成更准确和高效的代码。

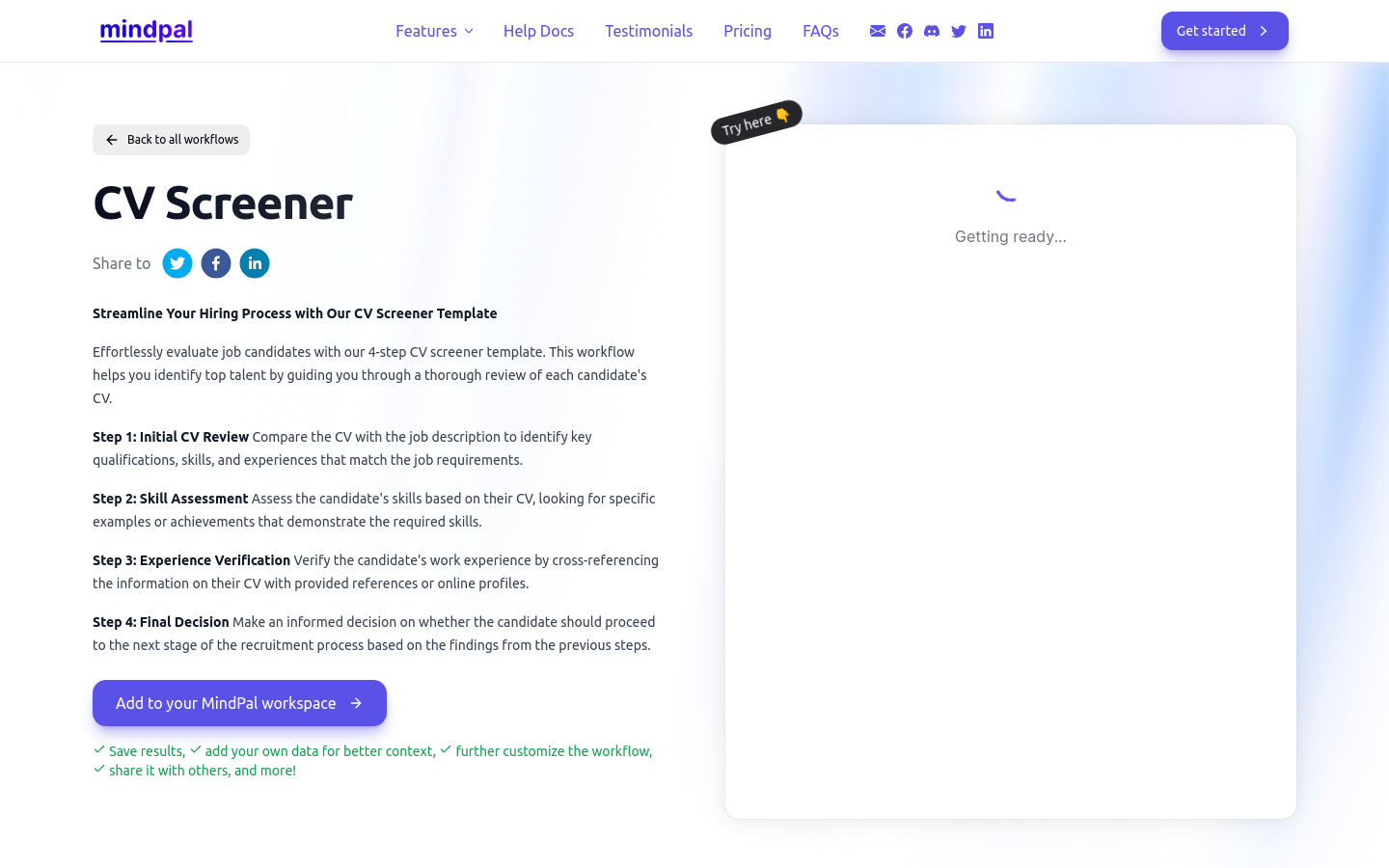

多轮对话系统(Multi-turn Dialogue Systems):NSA在多轮对话系统中的应用也非常广泛,能帮助系统在长对话中保持连贯性。适合需要理解和生成多轮对话的智能助手或聊天机器人。NSA通过动态分层稀疏策略,结合了粗粒度的Token压缩和细粒度的Token选择,同时通过滑动窗口保留局部上下文信息,在处理长对话时能够更好地捕捉上下文信息。

长文本处理(Long-text Processing):NSA在处理长文本方面具有显著优势,例如在处理新闻文章、学术论文或小说等长文本时。NSA能快速地识别出关键信息,生成高质量的摘要或翻译。

实时交互系统(Real-time Interactive Systems):在智能客服、在线翻译和虚拟助手等实时交互系统中,推理速度和实时性是关键指标。NSA的加速推理能力使其成为实时交互系统的理想选择。例如,在智能客服场景中,NSA可以在不到一秒的时间内理解用户的问题,生成准确的回答。

资源受限环境(Resource-constrained Environments):NSA的低预训练成本和高效推理能力能在移动设备、边缘计算和物联网等资源受限环境中发挥重要作用。例如,在移动设备上,NSA可以在有限的硬件资源下实现高效的文本处理和生成功能,为用户提供更加智能的语音助手和文本编辑工具。

通用基准测试(General Benchmarks):NSA在多个通用基准测试中表现出色,在多个指标上优于包括全注意力模型在内的所有基线。具有很好的通用性。

长上下文基准测试(Long-context Benchmarks):NSA在长上下文基准测试中也显示出了卓越的性能,例如在64k上下文的大海捞针测试中,NSA在所有位置上都实现了完美的检索准确率。

NSA存在哪些不足?

NSA作为一种新型的稀疏注意力机制,尽管在长文本建模和效率提升方面表现出色,但仍面临一些挑战:

硬件适配与优化的复杂性:NSA需要针对现代硬件(如GPU的Tensor Core)进行优化,以实现理论计算复杂度的降低。这种硬件对齐的优化需要在预填充和解码阶段都进行设计,避免内存访问和硬件调度的瓶颈。

训练阶段的支持不足:尽管NSA支持端到端训练,但现有的稀疏注意力方法大多集中在推理阶段,缺乏对训练阶段的有效支持。可能导致在长序列训练时效率低下,限制了模型在长文本任务中的进一步优化。

稀疏模式的动态调整:NSA通过动态分层稀疏策略实现效率提升,如何在不同任务和数据上动态调整稀疏模式仍是一个挑战。

与先进架构的兼容性问题:NSA需要与现代解码高效架构(如多查询注意力MQA和分组查询注意力GQA)兼容。一些现有的稀疏注意力方法在这些架构下表现不佳,因为它们无法有效利用KV缓存的共享机制。

性能与效率的平衡:NSA在实现效率提升的同时,需要保持与全注意力模型相当的性能。在某些任务中,稀疏注意力可能会导致性能下降,在需要处理复杂依赖关系的任务中。

可扩展性与通用性:NSA需要在不同规模的模型和任务中表现出色,设计可能需要针对特定任务进行调整。如何将NSA的稀疏模式推广到其他类型的模型(如视觉或多模态模型)也是一个待解决的问题。

NSA未来发展

NSA(Native Sparse Attention)新型稀疏注意力机制未来发展十分广阔。随着大语言模型(LLM)在深度推理、代码生成、多轮对话等复杂任务中的应用不断增加,长文本建模的需求日益凸显。然而,传统的全注意力机制因计算复杂度高、内存需求大,难以高效处理长序列。NSA通过动态分层稀疏策略和硬件对齐优化,大幅降低了计算成本,同时保持了模型性能。未来,NSA有望在长文本处理、实时交互系统、资源受限环境等场景中发挥重要作用。硬件对齐的设计能充分利用现代GPU的计算能力,进一步提升效率。NSA的创新为稀疏注意力机制的进一步发展提供了新思路,包括与多模态任务的结合、知识蒸馏的集成等。随着技术的不断进步,NSA及其衍生技术将成为下一代大语言模型的重要发展方向。

AI爱好者的一站式人工智能AI工具箱,累计收录全球10,000⁺好用的AI工具软件和网站,方便您更便捷的探索前沿的AI技术。本站持续更新好的AI应用,力争做全球排名前三的AI网址导航网站,欢迎您成为我们的一员。